Perkenalkan Sora, Kecerdasan Buatan Pembuat Video dari Teks

Sora menghasilkan video berdurasi hingga satu menit hanya dengan perintah teks sederhana.

Logo OpenAI terlihat ditampilkan di ponsel dengan gambar di layar komputer yang dihasilkan oleh model teks ke gambar Dall-E ChatGPT, Jumat (8/12/2023).

SAN FRANCISCO, JUMAT — Perusahaan OpenAI, pembuat aplikasi ChatGPT, kembali membuat gebrakan baru dengan meluncurkan Sora. Sora adalah kecerdasan buatan generatif yang mampu menghasilkan video realistis hanya dengan teks sederhana.

”Sora dapat menghasilkan video berdurasi hingga satu menit dengan tetap menjaga kualitas visual dan kepatuhan terhadap perintah pengguna,” kata OpenAI dalam sebuah pernyataan, Jumat (16/2/2024).

Baca juga: Etika Kecerdasan Artifisial Berlaku bagi Semua Penyelenggara Sistem Elektronik

Sora merupakan generasi terbaru kecerdasan buatan (AI) generatif. AI generatif adalah kecerdasan buatan yang dapat membuat teks, foto, dan video hanya dengan teks sederhana dari pengguna.

Saat ini, Sora sedang dalam tahap pengujian. OpenAI telah merilis beberapa video singkat yang sudah dihasilkan oleh Sora beserta teks masukan yang digunakan untuk menghasilkannya.

CEO OpenAI Sam Altman difoto pada 7 Februari 2023.

Selain video yang terlihat realistis, Sora juga dapat mengambil gambar diam dan menghasilkan video dari gambar diam tersebut. Sebelumnya, OpenAI telah meluncurkan kecerdasan buatan generatif, yaitu ChatGPT, yang berupa aplikasi percakapan dan DALL-E atau kecerdasan buatan yang dapat menghasilkan gambar hanya dengan perintah teks.

Baca juga: Mesin AI Generatif Amazon Bisa Cegah Informasi Sesat dan Ujaran Kebencian

CEO OpenAI Sam Altman di media sosial X mengatakan, perusahaannya menawarkan akses kepada sejumlah pembuat konten yang terbatas dalam tahap pengujian. Lewat X yang sebelumnya dikenal sebagai Twitter, Altman mengundang pengguna untuk memberi masukan perintah kepada Sora untuk diubah menjadi video.

Selanjutnya, video hasil perintah itu ia unggah di X beberapa saat kemudian. Salah satunya adalah video pendek dua anjing jenis golden retriever yang sedang melakukan siaran siniar (podcast) di gunung.

CEO OpenAI Sam Altman dalam sesi tentang kecerdasan buatan (AI) pada pertemuan tahunan Forum Ekonomi Dunia (WEF) di Davos, Swiss, 18 Januari 2024.

Video lain menunjukkan video makhluk setengah bebek setengah naga yang terbang melintasi matahari terbenam yang indah. Di punggung makhluk jadi-jadian itu duduk seekor hamster yang mengenakan perlengkapan petualangan di punggungnya.

Perusahaan rintisan (start up) yang memperoleh dukungan modal dari Microsoft itu memperingatkan bahwa model Sora yang dikeluarkan saat ini masih memiliki sejumlah kelemahan. Contoh kelemahan itu di antaranya konsep kiri dan kanan yang masih membingungkan atau gagal menjaga kesinambungan visual sepanjang video.

Kami akan melibatkan para pembuat kebijakan, pendidik, dan seniman di seluruh dunia untuk memahami kekhawatiran mereka dan mengidentifikasi kasus-kasus untuk penggunaan teknologi baru ini.

Dalam pengumumannya, OpenAI menyatakan, keamanan aplikasi akan menjadi prioritas utama. Untuk itu, Sora akan menjalani pengujian permusuhan (adversarial testing) oleh para pakar yang disebut juga pengujian tim merah (red teaming).

Pengujian tim merah ini merupakan salah satu perintah dari Presiden Joe Biden pada Oktober 2023. Perusahaan harus melakukan uji tim merah pada produk AI generatif yang dihasilkan untuk membuat teknologinya lebih aman.

Istilah tim merah telah digunakan selama bertahun-tahun dalam keamanan siber untuk mengidentifikasi risiko baru. Istilah ini mengacu pada simulasi Perang Dingin AS kala musuh diistilahkan sebagai tim merah.

CEO Alphabet Sundar Pichai (kiri) dan CEO OpenAI Sam Altman tiba di Gedung Putih untuk bertemu dengan Wakil Presiden Kamala Harris membahas tentang kecerdasan buatan, 4 Mei 2023, di Washington, AS.

Metode pengujian itu sengaja untuk membuat Sora malafungsi, menghasilkan konten tak pantas, atau keluar dari jalur dan melakukan kesalahan. ”Kami akan melibatkan para pembuat kebijakan, pendidik, dan seniman di seluruh dunia untuk memahami kekhawatiran mereka dan mengidentifikasi kasus-kasus untuk penggunaan teknologi baru ini,” sebut pernyataan OpenAI.

OpenAI juga membuat aplikasi untuk membantu mendeteksi konten menyesatkan, seperti pengklasifikasi deteksi yang dapat mengetahui kapan video dibuat oleh Sora.

Sora belum tersedia untuk umum. OpenAI baru mengungkapkan informasi terbatas tentang cara pembuatannya. OpenAI pun belum mengungkapkan sumber gambar dan video apa yang digunakan untuk melatih Sora. Sebelumnya, proses pelatihan ChatGPT menuai masalah hukum.

Saat ini, OpenAI tengah menghadapi gugatan hukum sejumlah penulis dan The New York Times atas penggunaan karya tulis berhak cipta untuk melatih ChatGPT tanpa meminta izin terlebih dulu.

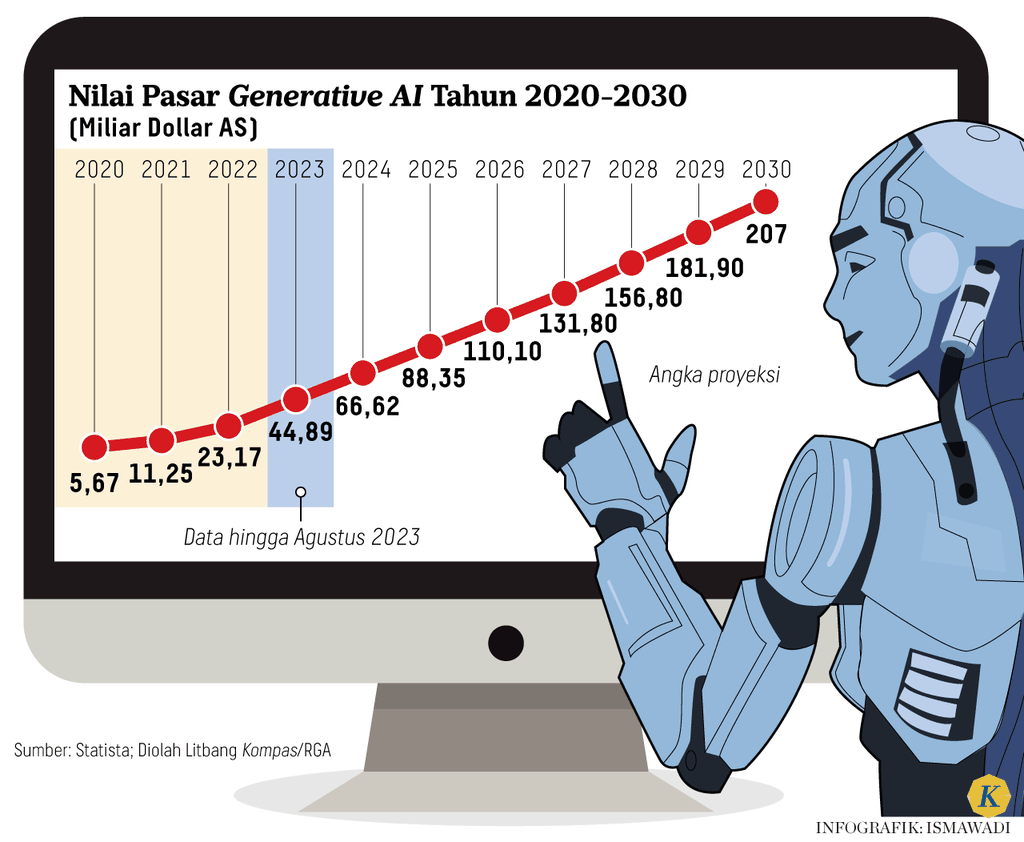

Selain OpenAI, Meta, Google, dan Runway AI sedang mengerjakan model pembuat video yang sama. Sejumlah video sampel telah diluncurkan ke publik. Pengembangan kecerdasan buatan generatif diperkirakan masih akan sangat meluas.

Ketakutan

Di sisi lain, pesatnya pengembangan AI generatif telah memicu ketakutan. AI jenis ini dapat membuat sejumlah pekerjaan tak diperlukan lagi, mengacaukan pemilu, berpotensi mengalahkan manusia, serta menimbulkan dampak bencana.

Foto pada 23 November 2023 memperlihatkan logo aplikasi ChatGPT yang dikembangkan oleh organisasi riset kecerdasan buatan AS, OpenAI, pada layar laptop (kanan) dan huruf AI pada layar ponsel pintar di Frankfurt am Main, Jerman.

Ketakutan tersebut terasa kuat di AS yang memasuki masa pemilihan presiden. Pemerintahan Biden, Kamis (8/2/2024), mengatakan, perusahaan-perusahaan AI terkemuka telah tergabung dalam konsorsium baru untuk pengembangan dan penerapan AI generatif yang aman.

Baca juga: Gambar Buatan Teknologi AI Kian Meresahkan

Menteri Perdagangan AS Gina Raimondo mengumumkan Konsorsium Institut Keamanan AI AS (AISIC), yang mencakup OpenAI, Google Alphabet, Anthropic, dan Microsoft bersama dengan Meta Platform induk Facebook, Apple, Amazon.com, Nvidia Palantir, Intel, JPMorgan Chase, dan Bank of America.

”Pemerintah AS mempunyai peran penting dalam menetapkan standar dan mengembangkan alat yang kita perlukan untuk memitigasi risiko dan memanfaatkan potensi besar kecerdasan buatan,” katanya.

Ajakan pengembangan AI beretika dalam Forum Ekonomi Dunia di Davos, Swiss, Kamis (18/1/2024).

Konsorsium tersebut mewakili kumpulan tim pengujian dan evaluasi terbesar AI. Fokusnya adalah membuat landasan bagi ilmu pengukuran baru dalam keamanan AI.

Konsorsium yang diikuti 200 perusahaan teknologi di AS itu akan berada di bawah koordinasi Institut Keamanan AI AS (USAISI). Kelompok tersebut ditugaskan untuk mengerjakan langkah prioritas yang diuraikan dalam perintah eksekutif AI oleh Presiden Biden pada Oktober 2023.

Baca juga: Pertaruhan Pemilu dan Kecurangan Era Kecerdasan Buatan

Perintah Biden mengarahkan lembaga-lembaga untuk menetapkan standar pengujian tersebut dan untuk mengatasi risiko kimia, biologi, radiologi, nuklir, dan keamanan siber terkait. Salah satunya mengembangkan pedoman untuk tim merah, evaluasi kemampuan, manajemen risiko, keselamatan dan keamanan, dan memberi tanda air pada konten sintetis.

Perusahaan-perusahaan AI besar telah berjanji untuk memberi tanda air (watermark) pada konten yang dihasilkan AI. Tujuannya, agar karya AI dapat dibedakan dari konten asli. (REUTERS/AP/AFP)